Intel日前举办了Vision 2024年度产业改造大会,亮点不少,堪称大幅卓绝NVIDIA H100的新一代AI加速器Gaudi 3、品牌全新升级的至强6、AI算力猛增的下一代超低功耗处理器Lunar Lake,齐蛊卦了不少宗旨。

不外关于AI缔造者、AI产业尤其是企业AI而言,此次大会上还有一件大事:

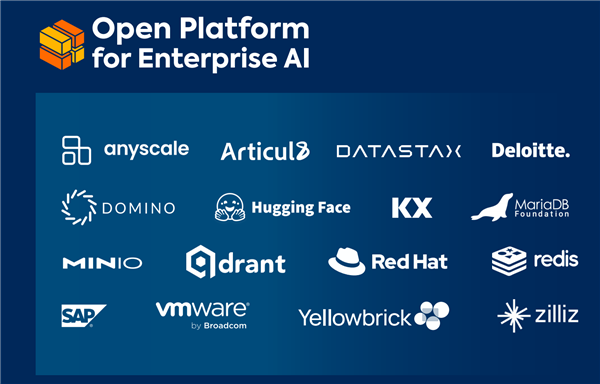

Intel集中浩繁行业巨头,发起了洞开企业AI平台,推动企业AI改造欺诈,同期通过超以太网定约(UEC)和一系列AI优化以太网管理决策,鼓励企业AI高速互连收罗改造。

如今说到大限制AI部署,许多东谈主脑海中会坐窝涌现两个名字:

一个是OpenAI,大模子和算法的独步天下;另一个是NVIDIA,硬件算力和生态的典型代表。

然则一样说到NVIDIA,以及CUDA为代表的生态圈,其一贯以来的禁闭作念法颇为东谈主所诟病,被誉为“硅仙东谈主”的芯片缔造大神 Jim Keller就一直对NVIDIA的作念法极为发火,责问CUDA不是护城河而是池沼,NVLink这种特有互连圭臬也应该放手。

坦荡说,NVIDIA AI不单是在硬件性能上“遥遥发轫”,更大的本钱恰是滥用十几年期间和无数好意思元砸出来的CUDA生态,成为其“摆布行业”、赚钱无数的制胜法宝。

只不外时期在变化,岂论企业如故缔造者,齐不但愿被管束在一个小圈子里,更但愿在洞开分享的寰宇里解放前行,这恰巧给了其他厂商追逐以致卓绝NVIDIA的大好契机。

Intel就瞅准这一趋势和需求,集中Anyscale、Articul8、DataStax、Domino、Hugging Face、KX Systems、MariaDB、MinIO、Qdrant、RedHat、Redis、SAP、VMware、Yellowbrick、Zilliz等浩繁行业伙伴告示,将集中创建企业AI洞开平台,助力企业推动AI改造。

它将为企业AI提供一个自下而上的齐备平台,底层基于Intel齐备障翳云、数据中心、角落、PC各个鸿沟的AI算力硬件,也等于XPU理念。

构筑其上的是圭臬化和可膨大的基础容貌生态、安全可靠的软件生态、洞开浅薄的欺诈生态,并且统统是对统统行业洞开的。

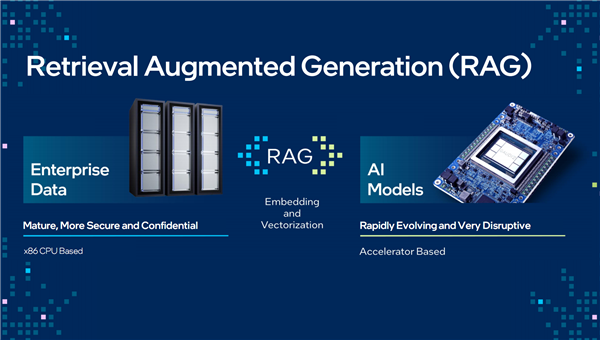

这一谋划凝结了全行业的力量,旨在缔造洞开的、多供应商的AIGC系统,通过RAG(检索增强生成)技能,提供一流的部署便利性、性能和价值。

关于企业刻下正在圭臬云基础容貌上初始的无数专罕有据源,RAG不错匡助他们通过洞开大讲话模子进行功能上的增强,从而加速AIGC在企业中的欺诈。

在Intel看来,坚抓开源洞开,并以此撬动洞开的AI生态速即发展,至关进攻。

Intel副总裁、Intel中国软件和先进技能行状部总司理李映在接受采访时暗示:“传统模式中,几家请示公司组建一个洞开定约,各自有明确单干,更多的是一个采纳问题。如今基于AI大模子的变化,洞开开源第一次和统统行业的技能改造爆发相合在沿途。当今,洞开开源和闭源同期出现,不再是采纳,而是一个当然演变、发展的经由。”

Intel院士、大数据技能人人首席技能官、大数据分析和东谈主工智能改造院院长戴金权也指出,一个洞开的生态,不错让兼并世态的改造互相促进,在新的欺诈场景不错互通。

统统行业齐在冉冉意志到,构建一个AIGC欺诈,并不是只需要一个大模子,一些起先进的系统管理决策,其实更多的是疏淡于构建一个AI系统来管理问题。

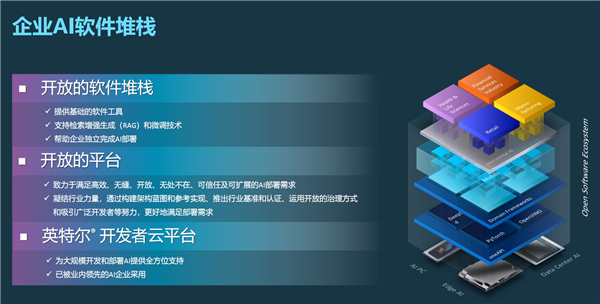

在这个企业AI洞开平台中,Intel的一个杰出重心等于加速构建洞开的AI软件生态,通过构建基础软件为缔造者提供便利,匡助大企业简化和深切AI的大限制缔造和部署。

李映指出,在洞开AI软件生态方面,关于Intel而言,异常进攻的一个点是怎样通过软件加速企业AI的发展,怎样把企业蓝本的云架构和将来基于大模子、数据的AI架构和会在沿途。

软件不错在这个经由中起到异常进攻的加速作用,而从统统软件堆栈的角度来讲,Intel恰是少量数不错确切在各个层面上通过软件提供优化、提供技能的头部企业之一。

同期,Intel一直在奋勉推动基于AI的软件改造,最典型的等于oneAPI,下载量照旧跨越100万次。

第三等于怎样匡助缔造者提高缔造恶果,其中很进攻的一部分等于Intel缔造者云平台。

它不但不错让缔造者最早斗争到最新的至强、Gaudi AI加速器,还能保证多样开源框架、组件在兼并环境中的兼容性,从而晋升缔造恶果、优化用户体验。

另皮毛当值得一提的是,Intel也在积极为开源社区孝顺技能、改造和教会,鼓励洞开圭臬。

比如,PyTorch已冉冉成为圭臬的AI框架,Intel一直齐是PyTorch异常靠前的进攻孝顺者,并以高档会员的身份加入了PyTorch基金会。

除了对PyTorch自己进行优化,Intel的一些技能改造齐参加到了PyTorch开源框架之中,让更多企业和缔造者分享,让统统AI软件框架愈加开源、洞开。

再比如openEuler、龙蜥这些开源的中国Linux社区,Intel对其的参加齐照旧和海外同步,以致在某些鸿沟发轫于海外上其他一些Linux的区分和发展。

临了再来转头一下Intel本次揭晓的三大算力产物。

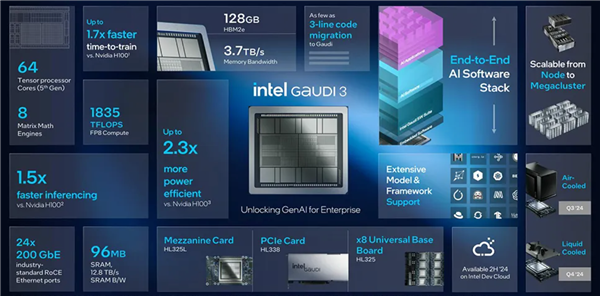

Gaudi 3 AI加速器接收台积电5nm工艺,配备8个矩阵引擎、64个张量中枢、96MB SRAM缓存、1024-bit 128GB HBM2E内存(带宽3.7TB/s),还有16个PCIe 5.0通谈、24个2000GbE收罗、JPEG/VP9/H.264/H.265解码器。

功耗有600/900W两个级别,提供OAM兼容夹层卡、通用基板、PCIe膨大卡三种时势。

Gaudi 3比拟上代领有2倍的FP8 AI算力(1835TFlops)、4倍的BF16 AI算力、2倍的收罗带宽、1.5倍的内存带宽。

Intel还宣称,它对比NVIDIA H100 LLM推感性能发轫50%、考研期间快40-70%,能效发轫最多达2.3倍。

另外,收获于宽绰、浅薄的缔造器具,缔造者最少只需改变3行代码,就能将其他AI欺诈移植到Gaudi 3之上。

全新的至强6包含两个分支,其中Sierra Forest第二季度发布,堪称至强处理器历史上最大的一次变革,初度接收纯能效核(E核)联想。

它重心针对恶果进行优化,相宜高密度、可膨大的责任负载,最多288中枢288线程。

按照官方说法,比拟第二代至强,Sierra Forest不错带来2.4倍的能效晋升,机架密度则不错提高2.7倍。

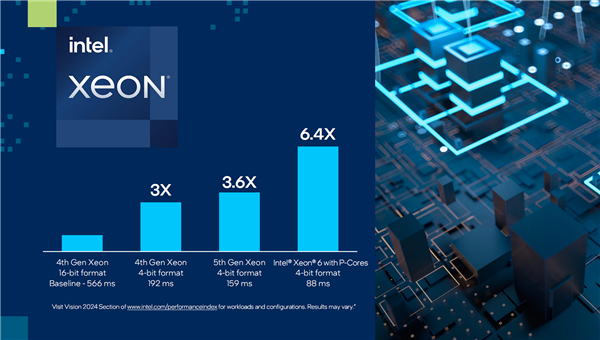

Granite Rapids则是传统的纯性能核(P核)联想,重心针对性能优化,适总缠绵密集型欺诈和高强度的AI负载。

它新增了对MXFP4数据容貌的软件赞成,好像初始700亿参数的Llama 2大模子,对比四代至强能将令牌蔓延裁减最多6.5倍。

代号Lunar Lake的下一代超低功耗酷睿Ultra处理器,AI算力将跨越100TOPS(100万亿次每秒),是现存一代酷睿Ultra Meteor Lake的足足三倍!

其中,单单是NPU单位就不错提供约莫45TOPS的算力,是面前的多达四倍,我方即可骄横微软界说下一代AI PC的需求。

不错说,Intel领有面前最为完善的AI体系,从底层障翳云霄、数据中心端、角落端、客户端的XPU硬件算力,到表层的收罗决策、缔造器具,再到凡俗的生态协作,如今又组建了洞开的企业AI平台,不错说万事俱备,在AI考研与他推理、AIGC鸿沟必定会有一番当作。

【本文适度】如需转载请务必注明出处:快科技

牵扯剪辑:上方文Q

声明:新浪网独家稿件,未经授权辞让转载。 -->